Serverless pada Cloud Computing

Serverless: Revolusi Komputasi Awan dan Tantangan yang Menyertainya

Dalam lanskap teknologi yang terus berkembang pesat, “serverless” telah muncul sebagai salah satu paradigma komputasi awan yang paling transformatif dan banyak diperbincangkan. Lebih dari sekadar tren, serverless mewakili pergeseran fundamental dalam cara aplikasi dibangun, di-deploy, dan diskalakan. Ini menjanjikan efisiensi biaya, skalabilitas tak terbatas, dan fokus yang lebih besar bagi pengembang pada logika bisnis inti, bukan pada manajemen infrastruktur. Namun, di balik janji-janji manis ini, serverless juga membawa serangkaian tantangan dan pertimbangan baru yang perlu dipahami secara mendalam.

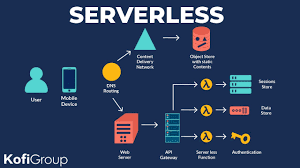

Secara fundamental, istilah “serverless” seringkali menimbulkan kebingungan. Ini bukan berarti tidak ada server sama sekali. Sebaliknya, ini berarti pengembang dibebaskan dari beban mengelola server. Infrastruktur server yang mendasari masih ada, tetapi sepenuhnya diabstraksi dan dikelola oleh penyedia layanan awut (cloud provider) seperti Amazon Web Services (AWS) Lambda, Google Cloud Functions, atau Azure Functions. Pengembang hanya perlu menulis kode fungsi mereka, mengunggahnya ke platform, dan penyedia layanan awan akan secara otomatis menyediakan, memelihara, dan menskalakan infrastruktur yang diperlukan untuk menjalankan kode tersebut sebagai respons terhadap peristiwa (events).

Pilar-Pilar Utama Serverless

Ada beberapa pilar kunci yang mendefinisikan paradigma serverless:

- Fungsi sebagai Unit Komputasi (Functions as a Service – FaaS): Ini adalah jantung dari serverless. Aplikasi dipecah menjadi fungsi-fungsi kecil dan mandiri yang merespons peristiwa tertentu. Misalnya, sebuah fungsi dapat dipicu ketika ada unggahan gambar baru ke penyimpanan awan, ketika ada entri baru di database, atau sebagai respons terhadap permintaan HTTP.

- Manajemen Server yang Diabstraksi: Pengembang tidak perlu khawatir tentang penyediaan server, konfigurasi OS, patching keamanan, atau penskalaan. Semua tugas operasional ini ditangani oleh penyedia layanan awan.

- Model Pembayaran Berbasis Penggunaan (Pay-per-Execution): Ini adalah salah satu daya tarik terbesar. Pengembang hanya membayar untuk waktu komputasi yang sebenarnya digunakan oleh fungsi mereka. Tidak ada biaya ketika kode tidak berjalan. Ini sangat kontras dengan model VM tradisional di mana pengguna membayar untuk instans server yang berjalan 24/7, terlepas dari apakah server tersebut aktif digunakan atau tidak.

- Skalabilitas Otomatis: Platform serverless secara otomatis menskalakan fungsi naik atau turun sesuai dengan permintaan. Jika ada lonjakan lalu lintas, platform akan secara instan memunculkan lebih banyak instans fungsi untuk menangani beban, dan kemudian menskalakan kembali ketika permintaan berkurang. Ini menghilangkan kebutuhan untuk perencanaan kapasitas yang rumit.

- Peristiwa-Driven (Event-Driven): Aplikasi serverless dibangun di sekitar arsitektur berbasis peristiwa. Fungsi-fungsi dipicu oleh berbagai jenis peristiwa, yang dapat berasal dari sumber internal (misalnya, perubahan database, unggahan file) atau eksternal (misalnya, permintaan API, notifikasi IoT).

Manfaat Serverless

Adopsi serverless didorong oleh sejumlah manfaat yang signifikan:

- Pengurangan Biaya Operasional (OpEx): Ini adalah salah satu daya tarik utama. Dengan model pembayaran berbasis penggunaan, organisasi dapat secara drastis mengurangi biaya infrastruktur, terutama untuk beban kerja dengan lalu lintas sporadis atau tidak teratur. Tidak ada lagi pembayaran untuk kapasitas idle. Selain itu, biaya untuk tim operasi dan SRE (Site Reliability Engineering) untuk mengelola server juga berkurang.

- Peningkatan Produktivitas Pengembang: Dengan mengalihkan fokus dari manajemen infrastruktur ke penulisan kode, pengembang dapat menjadi lebih produktif. Mereka dapat berinovasi lebih cepat dan sering, karena siklus pengembangan dan deployment menjadi lebih singkat.

- Skalabilitas yang Tidak Tertandingi: Kemampuan untuk secara otomatis menskalakan dari nol hingga ribuan atau bahkan jutaan eksekusi per detik tanpa intervensi manual adalah keunggulan besar. Ini memungkinkan aplikasi untuk menangani lonjakan lalu lintas yang tidak terduga, seperti selama penjualan flash atau peristiwa viral.

- Waktu ke Pasar yang Lebih Cepat: Dengan abstraksi infrastruktur, waktu yang dibutuhkan untuk meluncurkan produk atau fitur baru dapat sangat dipersingkat. Pengembang dapat fokus pada fitur-fitur yang memberikan nilai bisnis.

- Ketahanan (Resiliency) yang Lebih Baik: Penyedia layanan awan membangun platform serverless mereka dengan redundansi dan toleransi kesalahan yang tinggi. Fungsi-fungsi dijalankan di lingkungan terisolasi, sehingga kegagalan satu fungsi tidak akan menjatuhkan seluruh aplikasi.

Kasus Penggunaan Umum Serverless

Serverless sangat cocok untuk berbagai kasus penggunaan, antara lain:

- Pemrosesan Data Real-time: Memproses aliran data dari perangkat IoT, log aplikasi, atau umpan berita saat data tersebut masuk.

- Backend API: Membangun API RESTful atau GraphQL untuk aplikasi web dan seluler.

- Aplikasi Web Statis dengan Backend Dinamis: Menggabungkan situs web statis (yang di-hosting di layanan penyimpanan awan) dengan fungsi-fungsi serverless untuk fungsionalitas dinamis seperti otentikasi pengguna, formulir, atau integrasi database.

- Pemrosesan Media: Mengubah ukuran gambar, mengodekan video, atau membuat thumbnail saat media diunggah.

- Chatbots dan Asisten Virtual: Menerima input pengguna dan memprosesnya menggunakan fungsi serverless untuk menghasilkan respons.

- Otomatisasi Operasional: Menjalankan tugas-tugas terjadwal seperti cadangan database, pelaporan, atau pembersihan data.

- Backend untuk Aplikasi Mobile: Menyediakan layanan backend untuk aplikasi seluler tanpa perlu mengelola server.

Tantangan dan Kekurangan Serverless

Meskipun menjanjikan banyak manfaat, serverless juga memiliki serangkaian tantangan yang perlu dipertimbangkan:

- Vendor Lock-in: Setiap penyedia layanan awan memiliki implementasi FaaS mereka sendiri dengan API, SDK, dan ekosistem yang unik. Memigrasikan aplikasi serverless dari satu penyedia ke penyedia lain bisa menjadi tugas yang kompleks dan memakan waktu. Ini adalah salah satu kekhawatiran terbesar bagi banyak organisasi.

- Cold Starts: Ketika sebuah fungsi serverless tidak dipanggil untuk beberapa waktu, instansnya mungkin “dimatikan” untuk menghemat sumber daya. Panggilan pertama setelah periode tidak aktif ini, yang disebut “cold start”, akan memakan waktu lebih lama karena platform harus menginisialisasi lingkungan eksekusi dan memuat kode fungsi. Untuk aplikasi yang sensitif terhadap latensi, cold starts dapat menjadi masalah.

- Debugging dan Monitoring yang Kompleks: Debugging aplikasi serverless yang didistribusikan secara intrinsik bisa jadi sulit. Fungsi-fungsi dapat dipicu oleh berbagai peristiwa dan berjalan di lingkungan yang terisolasi, membuat jejak eksekusi lebih sulit dilacak. Alat monitoring tradisional mungkin tidak cukup. Meskipun ada peningkatan alat APM (Application Performance Monitoring) yang dirancang untuk serverless, ini tetap menjadi tantangan yang lebih besar dibandingkan dengan aplikasi monolitik.

- Manajemen Status (Statelessness): Fungsi serverless pada dasarnya stateless, yang berarti mereka tidak mempertahankan status atau data antara eksekusi. Ini mengharuskan pengembang untuk menyimpan semua status eksekusi di layanan eksternal (misalnya, database, penyimpanan objek, atau cache). Meskipun ini mendorong arsitektur yang kuat, ini juga menambah kompleksitas dalam desain aplikasi.

- Batas Sumber Daya: Penyedia layanan awan memberlakukan batas pada sumber daya (memori, waktu eksekusi, ukuran paket deployment) yang dapat digunakan oleh sebuah fungsi. Fungsi yang membutuhkan waktu eksekusi yang sangat lama atau memori yang besar mungkin tidak cocok untuk model serverless.

- Keamanan: Meskipun penyedia layanan awan bertanggung jawab atas keamanan infrastruktur cloud, pengembang tetap bertanggung jawab atas keamanan kode dan konfigurasi mereka. Mengelola izin antar fungsi dan layanan lainnya, serta memastikan keamanan data, bisa jadi rumit.

- Overhead Jaringan dan Konfigurasi: Meskipun fungsinya kecil, interaksi antara fungsi dan layanan lain (database, antrean pesan) dapat memperkenalkan overhead jaringan. Mengelola konfigurasi dan dependensi yang kompleks di seluruh fungsi juga bisa menjadi tantangan.

- Biaya yang Tidak Terduga (untuk Beban Kerja Tertentu): Meskipun model pembayaran berbasis penggunaan seringkali menghemat biaya, untuk beban kerja yang sangat konstan dan dengan volume tinggi, menjalankan server tradisional atau kontainer yang berdedikasi mungkin sebenarnya lebih murah dalam jangka panjang, karena biaya per eksekusi serverless bisa menjadi signifikan jika volume sangat tinggi.

Masa Depan Serverless

Meskipun tantangan-tantangan ini ada, tren menuju serverless tampaknya akan terus berlanjut. Penyedia layanan awan terus berinvestasi dalam meningkatkan platform mereka, mengatasi masalah seperti cold starts, dan menyediakan alat debugging serta monitoring yang lebih baik.

Konsep serverless juga berkembang melampaui FaaS murni. “Serverless” kini mencakup banyak layanan terkelola lainnya yang tidak memerlukan manajemen server, seperti database serverless (misalnya, Amazon Aurora Serverless, Google Cloud Firestore), antrean pesan serverless (misalnya, Amazon SQS, Azure Service Bus), dan bahkan layanan container serverless (misalnya, AWS Fargate, Google Cloud Run). Ini menunjukkan bahwa filosofi “tanpa manajemen server” menyebar ke seluruh tumpukan teknologi, memperluas cakupan dan potensi serverless.

Seiring dengan kematangan ekosistem serverless, kita dapat mengharapkan adopsi yang lebih luas di perusahaan besar, pengembangan pola desain dan praktik terbaik yang lebih canggih, dan munculnya lebih banyak alat yang dirancang khusus untuk pengembangan dan pengelolaan aplikasi serverless. Integrasi dengan teknologi lain seperti AI/ML dan edge computing juga akan menjadi area pertumbuhan.

Kesimpulan

Serverless mewakili evolusi signifikan dalam komputasi awan, menawarkan efisiensi, skalabilitas, dan kecepatan inovasi yang belum pernah ada sebelumnya. Ini memungkinkan pengembang untuk benar-benar fokus pada apa yang mereka lakukan terbaik: menulis kode yang memecahkan masalah bisnis. Namun, seperti halnya teknologi baru lainnya, ia datang dengan serangkaian pertimbangan dan tantangan. Vendor lock-in, cold starts, serta kompleksitas debugging dan monitoring adalah rintangan yang harus diatasi.

Bagi organisasi yang siap merangkul perubahan dan berinvestasi dalam memahami nuansa serverless, potensinya untuk mengubah operasi TI dan mendorong inovasi adalah sangat besar. Serverless bukan hanya tentang menghilangkan server; ini tentang mengoptimalkan nilai bisnis, mengurangi gesekan operasional, dan mempercepat langkah menuju masa depan yang lebih dinamis dan efisien di awan. Dengan memahami manfaat dan kekurangannya, perusahaan dapat secara strategis memanfaatkan serverless untuk membangun aplikasi yang lebih tangkas, resilient, dan hemat biaya.

Serverless telah merevolusi komputasi awan dengan membebaskan pengembang dari manajemen server, menawarkan efisiensi biaya berbasis penggunaan dan skalabilitas otomatis yang luar biasa. Ini mempercepat waktu ke pasar dan meningkatkan produktivitas pengembang. Namun, tantangan seperti vendor lock-in, cold starts, dan kompleksitas debugging tetap ada. Meskipun demikian, tren serverless terus berkembang melampaui FaaS, mencakup berbagai layanan terkelola. Memahami pro dan kontra ini krusial. Serverless bukan hanya tentang menghilangkan server; ini adalah tentang mendorong inovasi, mengoptimalkan operasi TI, dan membangun aplikasi yang lebih tangkas dan hemat biaya di masa depan komputasi awan.